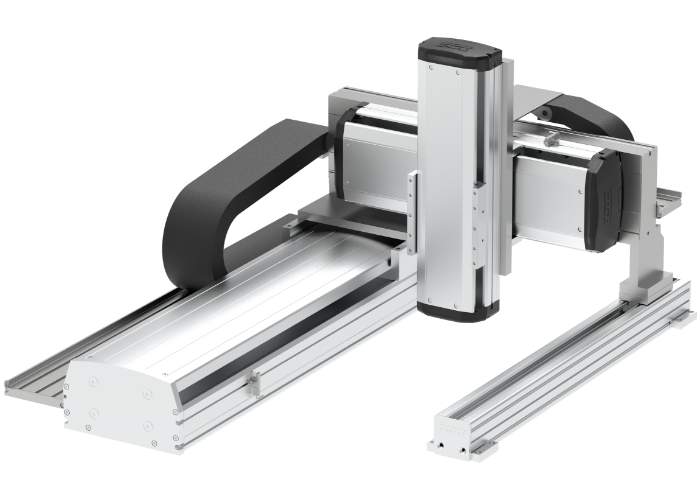

Danh mục sản phẩm toyorobot

Die Kullback-Leibler-Divergenz: Wie Information misst und formt

Die Kullback-Leibler-Divergenz, oft als KL-Divergenz abgekürzt, ist ein fundamentales Konzept der Informationstheorie, das Abweichungen zwischen Wahrscheinlichkeitsverteilungen quantifiziert. Sie misst, wie viel Information verloren geht, wenn eine Verteilung durch eine andere approximiert wird – ein Maß für die „Distanz“ zwischen Datenmustern, das über reine Zahlen hinaus interpretiert werden kann.

1. Die KL-Divergenz: Informationsverlust als Maß

Die KL-Divergenz \(D_{\text{KL}}(P \parallel Q)\) berechnet sich aus:

\[

D_{\text{KL}}(P \parallel Q) = \sum_{x} P(x) \log \frac{P(x)}{Q(x)}

\]

für diskrete Verteilungen, wobei \(P\) die tatsächliche Verteilung und \(Q\) die approximierte darstellt. Ein Wert von Null bedeutet, dass \(P\) und \(Q\) identisch sind. Je größer der Wert, desto weiter sind die Verteilungen voneinander entfernt – und desto mehr Information geht verloren.

Diese Divergenz ist nicht symmetrisch und hängt empfindlich von Nullwahrscheinlichkeiten ab: Wenn \(Q(x) = 0\) und \(P(x) > 0\), wird die Divergenz unendlich. Solche Randfälle verdeutlichen, warum mathematische Sorgfalt – etwa durch die Riemannsche Zahlenkugel oder Möbius-Transformationen – notwendig ist, um die Struktur der Verteilungen konsistent zu bewahren.

2. Die Riemannsche Zahlenkugel als geometrisches Modell

Die Zahlenkugel, erweitert um den Punkt im Unendlichen, bietet eine elegante geometrische Darstellung komplexer Verteilungen. Die Möbius-Transformation bildet die komplexe Ebene auf sich selbst ab und erhält Winkel – ein Prinzip, das Veränderung und Stabilität zugleich widerspiegelt. Die Bedingung \(ad – bc \ne 0\) gewährleistet, dass die Transformation invertierbar bleibt und Datenräume topologisch sinnvoll verformt.

Gerade diese mathematische Struktur hilft zu verstehen, wie die KL-Divergenz als Maß für Informationsabstand funktioniert: Sie zeigt, wie sich Verteilungen nicht nur numerisch, sondern auch als geometrische Verschiebungen im Raum unterscheiden – eine Brücke zwischen abstrakter Theorie und konkreter Wahrnehmung.

3. Das Lucky Wheel: Ein visuelles Modell für Verteilungsdifferenzen

Das Lucky Wheel, ein anschauliches Modell für Wahrscheinlichkeitsverteilungen, visualisiert Verteilungen als gleichmäßig rotierende Segmente mit unterschiedlichen Gewichtungen. Jede Position repräsentiert eine Verteilung, und die „Drehung“ spiegelt deren Informationsgehalt wider. Durch Veränderung der Gewichtungsverhältnisse – etwa bei Modellabweichungen – verschiebt sich das Rad, und die Verschiebung der Erwartungswerte und Entropien lässt sich direkt am Rad ablesen.

Dies macht die KL-Divergenz greifbar: Die physische Drehung ist die greifbare Form des Informationsverlusts zwischen Verteilungen. So wird abstrakte Theorie erlebbar – ein Modell, das die Dynamik der Datenveränderung in der Informationstheorie lebendig macht.

4. Von Theorie zu Praxis: KL-Divergenz im Datenalltag

In der Praxis dient die KL-Divergenz als zentrales Kriterium im maschinellen Lernen. Sie hilft, Vorhersagemodelle gegen reale Daten zu testen, indem sie den Informationsabstand zwischen verteilten Zuständen misst. Das Lucky Wheel unterstützt diesen Prozess, indem es die Divergenz als physische Bewegung darstellt – eine mächtige Metapher dafür, wie sich Daten voneinander unterscheiden und wie genau diese Unterschiede gemessen werden können.

Die Grenzen der KL-Divergenz – Nicht-Symmetrie, Empfindlichkeit gegenüber Nullwerten – zeigen, wo mathematische Fundamente wie die Theorie Liouvilles oder Cauchy-Riemanns für mathematische Konsistenz sorgen. Gerade hier wird die Zahlenkugel als topologisches Hilfsmittel wirksam, das Strukturen sichtbar macht und Fehlerquellen aufzeigt.

5. Fazit: Information als Dynamik der Verteilung

Die KL-Divergenz verbindet abstrakte Informationstheorie mit konkreter Wahrnehmung: Sie misst, wie Daten durch Abweichungen an Informationsgehalt verlieren – und das nicht nur in Zahlen, sondern als räumliche, geometrische und messbare Veränderung. Das Lucky Wheel ist dabei kein bloßes Spiel, sondern ein tiefgründiges Modell, das die Dynamik von Verteilungen und ihre Differenzen verständlich macht.

Die Zahlenkugel und die Möbius-Transformation veranschaulichen, dass Information nicht statisch ist, sondern dynamisch durch Verteilungsveränderungen fließt. Informationsmessung ist daher mehr als Zahl – sie ist die Sprache, mit der Daten Welten formen.