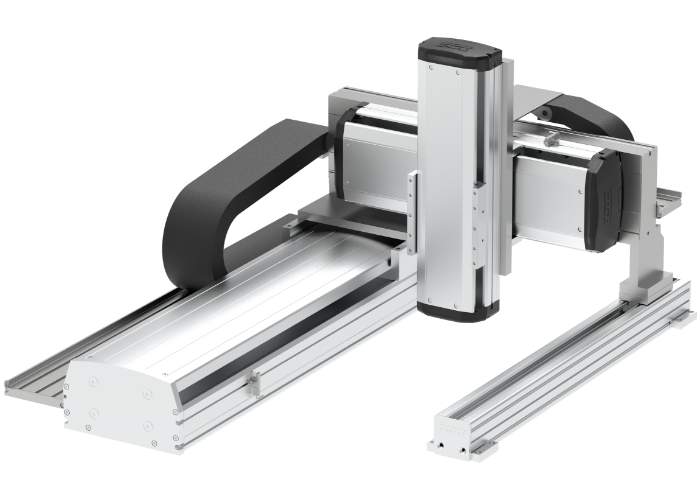

Danh mục sản phẩm toyorobot

Implementare un Controllo Qualità del Tono Linguistico Automatico in Italiano: Una Guida Esperta Passo-Passo

Nell’era dell’AI generativa, garantire che i contenuti linguistici prodotti mantengano un tono autentico, coerente e culturalmente appropriato in italiano rappresenta una sfida cruciale. A differenza di lingue con maggiore tolleranza stilistica, l’italiano richiede un’attenzione particolare al registro formale, al registro emotivo e alle sfumature idiomatiche, al fine di non compromettere fiducia e credibilità del brand. Questo approfondimento, ancorato al Tier 2 {tier2_url}, esplora la costruzione avanzata di un sistema di controllo qualità del tono automatico, passo dopo passo, con metodologie tecniche precise e applicazioni pratiche per esperti nell’ambito del content management in lingua italiana.

Architettura Metodologica per il Controllo Qualità del Tono Automatico

Il tono linguistico automatico va oltre la semplice scelta tra formale e informale: richiede una mappatura precisa di formalità, intensità emotiva (positiva, neutra, negativa), lessico specifico settoriale e aderenza al registro intentivo. A differenza di lingue come l’inglese, dove il tono può essere più flessibile, in italiano il tono è fortemente legato a convenzioni culturali, uso di forme di cortesia (“Lei”), espressioni idiomatiche e contesto comunicativo. Un modello AI generico rischia di produrre testi tecnicamente corretti ma culturalmente inautentici, generando dissonanza con il brand e gli utenti italiani. Pertanto, la metodologia Tier 2 si fonda su un glossario stilistico personalizzato, un addestramento supervisionato con vincoli linguistici e un sistema di scoring basato su metriche NLP avanzate.

1. Creazione del Glossario Stilistico Personalizzato

La base operativa è un glossario linguistico-tema, strutturato per tono, registro, intento e contesto settoriale. Per esempio:

- Formale Istituzionale: uso obbligatorio di “Lei”, frasi complete, lessico tecnico preciso (es. “si raccomanda” vs “consiglio”), assenza di abbreviazioni.

- Formale Marketing: tono positivo, lessico persuasivo, fraseologia dinamica ma controllata (es. “Scopri come…” con verbio all’imperativo modulato).

- Neutro Comunicazione istituzionale: registrazione equilibrata, assenza di giudizi soggettivi, tono distaccato ma chiaro (es. “I dati indicano…”).

Il glossario deve includere esempi regionali: ad esempio, in Italia centrale “facciamo” è più naturale di “noi facciamo”, mentre in Lombardia si preferisce “ci facciamo”. Questa personalizzazione evita incomprensioni culturali e aumenta la credibilità. Il glossario si arricchisce con annotazioni manuali su espressioni idiomatiche, sfumature emotive e usi dialettali se rilevanti (es. “va bene” in Sicilia con connotazione informale).

2. Fine-tuning Supervisionato con Vincoli Stilistici

L’addestramento del modello linguistico (es. BERT italiano o una variante fine-tunata) si basa su un corpus di testi autentici italiani: manuali, blog aziendali, comunicazioni ufficiali, articoli di settore. Il processo prevede tre fasi chiave:

- Fase A: Data Augmentation con Parafrasi Controllate

Si generano varianti testuali mantenendo tono, intento e registro, mediante parafrasi guidate da regole linguistiche (es. “Il progetto è pronto” → “Il progetto è stato completato con successo”). Questo espande la varietà senza alterare la coerenza stilistica. - Fase B: Addestramento Supervisionato con Loss Function Personalizzata

Si definiscono loss function che penalizzano deviazioni dal tono target:

– Loss di distanza semantica (es. embedding cosine tra vettori di frasi target e generate),

– Loss di formalità (classificatore che valuta registro formale),

– Loss di coerenza emotiva (analisi sentiment con focus su tono neutro/positivo).

Il modello apprende a discriminare tra toni incoerenti e autentici. - Fase C: Validazione Incrociata con Regole Linguistiche Esplicite

Si implementa un validatore NLP basato su spaCy e LingPipe, che verifica:

– Presenza di forme di cortesia (“Lei”, “grazie”),

– Correttezza sintattica e lessicale settoriale,

– Assenza di errori idiomatici o regionalismi fuori contesto.

3. Sistema di Scoring Qualitativo del Tono

Un sistema automatico efficace richiede metriche oggettive che vanno oltre la perplessità (perplexity) e includano:

- Punteggio di coerenza tonale: analisi NLP su entropia semantica e consistenza lessicale rispetto al tono target (es. 0.82

- Distanza semantica dal target: calcolata tramite embedding stilistici (es. WordNet italiano annotato con toni)

- Aderenza al registro: classificazione automatica (formale, neutro, colloquiale) con metriche di confidenza

Queste metriche sono integrate in una dashboard dinamica che visualizza il livello di autenticità per ogni segmento testuale, con alert in caso di deviazioni >15%. Il sistema genera report dettagliati per analisi post-pubblicazione.

4. Implementazione Operativa: Dal Modello alla Pipeline di Controllo

La pipeline integrata comprende:

- Fase 1: Raccolta e Annotazione di Dati

Selezionare corpus rappresentativi (blog, comunicazioni, social media) e annotare manualmente tono (emotivo, formale), registro (neutro, positivo), intento e contesto. Strumenti come Brat o Label Studio facilitano l’annotazione collaborativa con lingue italiane. - Fase 2: Addestramento e Validazione

Fine-tuning con loss personalizzate e validazione tramite validatore NLP basato su regole linguistiche. Testing A/B su campioni utenti per valutare percezione reale del tono. - Fase 3: Deployment con API di Controllo

Integrare un endpoint REST (es. con FastAPI) che riceve testi AI, applica il modello fine-tunato e restituisce un punteggio di qualità tonale e suggerimenti correttivi. - Fase 4: Monitoraggio e Feedback Loop

Analizzare post-pubblicazione recensioni, commenti e segnalazioni utente. Aggiornare il modello con nuovi dati e correggere deviazioni tramite active learning. - Fase 5: Calibrazione Uomo-Macchina

Revisione linguistica su casi limite (es. ironia, sarcasmo, riferimenti culturali) da parte di esperti linguisti italiani. Il feedback arricchisce il dataset e migliora l’algoritmo.

5. Errori Comuni e Best Practice per il Controllo del Tono

Un’implementazione superficiale genera problemi ricorrenti:

- Rigidità eccessiva: modelli troppo vincolati producono testi meccanici. Soluzione: bilanciare formalità con flessibilità tramite sampling controllato e regole linguistiche adaptive.

- Sottovalutazione del contesto culturale: uso di “grazie” senza contesto può apparire forzato. Soluzione: addestrare su corpus regionali e integrare varianti dialettali quando rilevanti.

- Mancata personalizzazione settoriale: un modello generico non riconosce il registro del marketing è diverso da quello bancario. Soluzione: training su dataset di dominio specifico con annotazioni tematiche.

- Ignorare il feedback utente: senza segnalazioni, il sistema non apprende dai fallimenti. Soluzione: interfaccia semplice per segnalare incoerenze tonali, con analisi automatica delle cause.

- Overfitting su corpus ristretti: risultati distorti se i dati non coprono variazione stilistica. Mitigazione: arricchire con dati multilingue e cross-dominio (legale, marketing, tech).